Lange Zeit galten KI-Tools in der Entwicklung vor allem als smarte Autovervollständigung. Man tippt einen Kommentar, die KI spuckt einen Code-Schnipsel aus. Doch das ist Schnee von gestern. Die wahre Magie beginnt, wenn man aufhört, einzelne Code-Blöcke zu generieren, und anfängt, ein ganzes Team von Spezialisten zu dirigieren.

In den letzten Wochen habe ich in meinem Projekt Themerus (einer WPF-Desktop-App unter .NET 10) genau das auf die Spitze getrieben. Ich habe nicht mit einer einzigen, allwissenden KI gesprochen, sondern ein Orchester aus spezialisierten Agenten aufgebaut.

Das Ergebnis? Ein absolutes “Aha”-Erlebnis.

Mein Agenten-Team

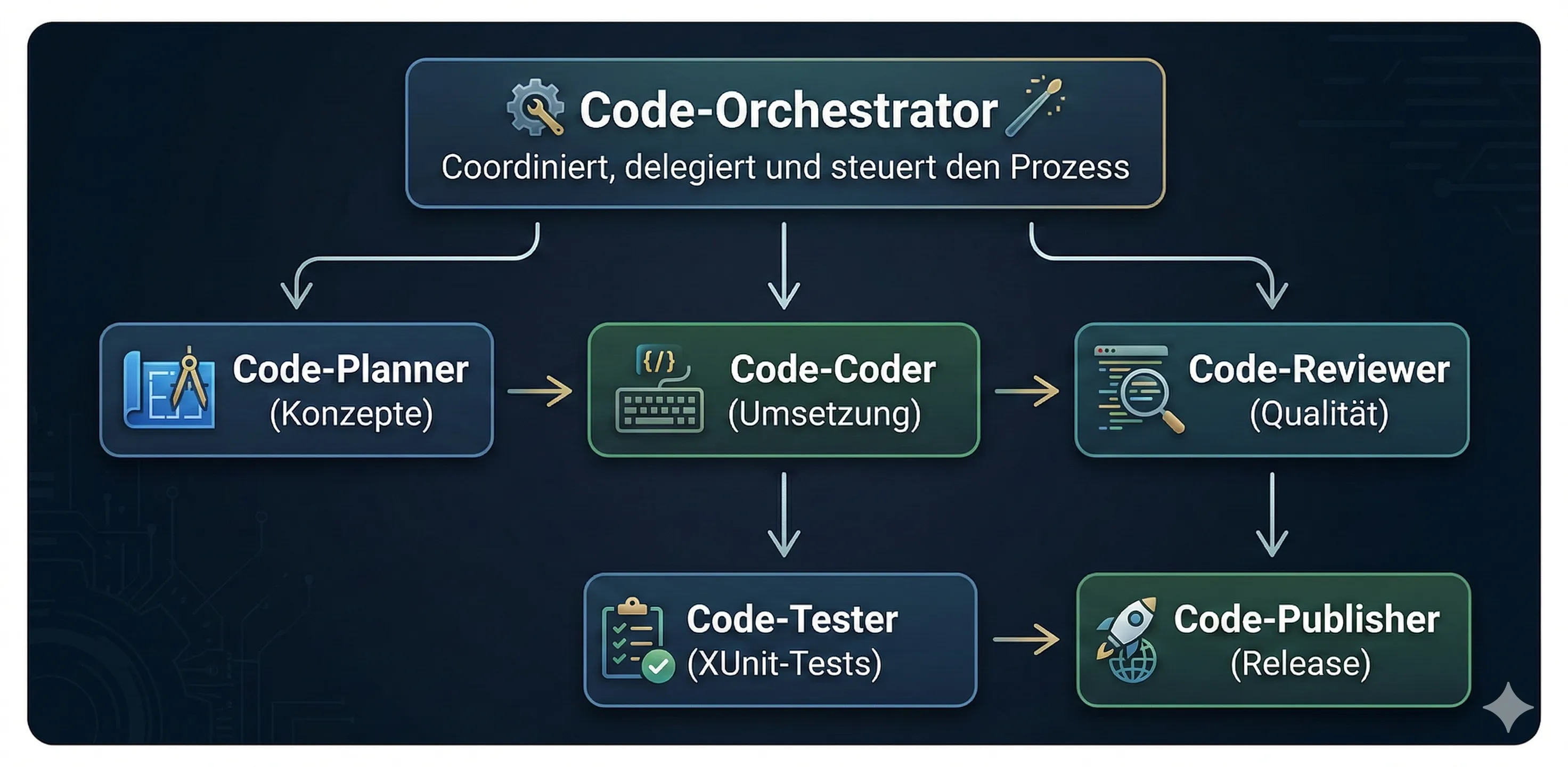

Das Setup in OpenCode bestand nicht aus einem monolithischen Chatbot, sondern aus klaren, voneinander getrennten Rollen. Hier ist der Workflow, wie die Agenten zusammenarbeiten:

- Der Code-Orchestrator: Der Projektleiter, der die Aufgaben verteilt.

- Der Code-Planner: Erstellt den verbindlichen Implementierungsplan, ohne selbst Code zu schreiben.

- Der Code-Critic: Ein schonungsloser Prüfer. Er sucht nach Logikfehlern, Architekturbrüchen und Edge-Cases.

- Der Code-Coder: Der fleißige Entwickler.

- Der Code-Tester & Reviewer: Schreiben fehlende XUnit-Tests und prüfen auf Best Practices.

- Der Code-Publisher: Kümmert sich um Release-Notes, Versionierung und das Deployment.

Die Magie der Iteration

Als ich das Team zum ersten Mal auf die Codebasis losgelassen habe, war ich skeptisch. Doch ein Blick in die Logs einer meiner Sessions zeigte ein faszinierendes Bild: Ich gab lediglich die Anweisung, das Projekt kritisch zu prüfen.

Ohne weiteres Zutun von mir beauftragte der Orchestrator den Kritiker. Dieser durchforstete die Architektur, glich sie mit den Vorgaben in meiner AGENTS.md ab und fand prompt ein “P0-Risiko”: Ein unerwünschtes Verhalten beim Start mehrerer Anwendungs-Instanzen. Er identifizierte die genauen Codezeilen (App.xaml.cs und MainWindow.xaml.cs) und legte den Finger in die Wunde.

Anschließend übernahm der Planner, der Coder schrieb den Fix, der Tester sicherte ihn ab und der Publisher bereitete das Release vor. Das alles passierte komplett autonom.

Mein größtes Learning aus diesem Projekt: Wenn das Orchester durch mehrere Iterationen gut aufeinander abgestimmt ist, dann funktionieren neue Anforderungen völlig fehlerfrei bis hin zum Publishing. Keine Endlosschleifen, keine Flüchtigkeitsfehler, kein ständiges Eingreifen des Entwicklers.

Fazit: Empowerment durch Delegation

Wir Entwickler müssen umdenken. Es geht künftig weniger darum, die Syntax einer Sprache perfekt zu beherrschen, sondern darum, Systeme und Agenten sauber zu orchestrieren. Klare Regeln, strenge System-Prompts und dedizierte Rollenverteilungen machen den Unterschied zwischen einem KI-Spielzeug und einer echten, autonomen Release-Maschine.

Wie geht es weiter? Du entscheidest!

Ich möchte dieses Thema weiter vertiefen. Welcher Bereich interessiert dich am meisten? Schreib mir einfach kurz per E-Mail oder über mein Kontaktformular deine Wunsch-Nummer. Das Thema mit den meisten Stimmen gewinnt und wird mein nächster Fachartikel hier auf dem Blog!

- Deep-Dive: So schreibe ich System-Prompts für gnadenlose Code-Review-Agenten

- Grenzen setzen: Sicherheitsrisiken bei autonomen Agenten-Systemen minimieren

- Von 0 auf 100: XUnit-Tests vollautomatisch von KI generieren lassen

Du willst solche Agenten-Setups in deinem eigenen Unternehmen oder Team einführen? Lass uns sprechen – ich zeige dir in meinen Workshops, wie du Automatisierung und PowerShell-Security mit KI auf das nächste Level hebst.